Estou com medo. Muito assustado.

A vigilância e a censura em toda a Internet, possibilitadas pelo poder computacional inimaginavelmente vasto da inteligência artificial (IA), estão aqui.

Esta não é uma distopia futurista. Está acontecendo agora.

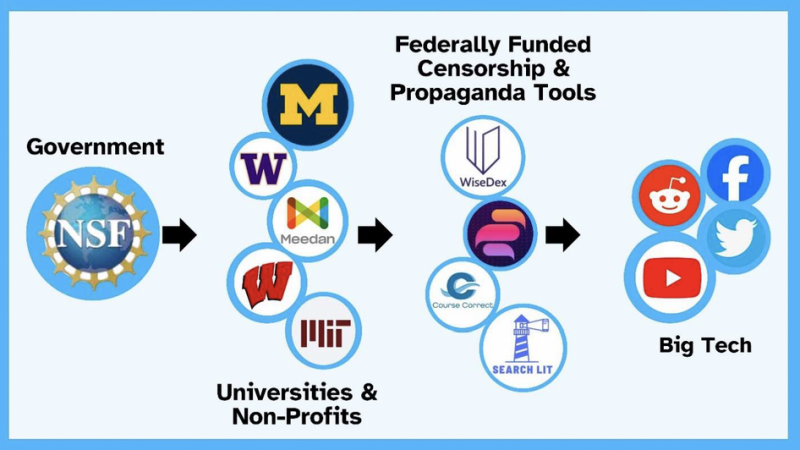

As agências governamentais estão a trabalhar com universidades e organizações sem fins lucrativos para utilizar ferramentas de IA para vigiar e censurar conteúdos na Internet.

Isto não é político ou partidário. Não se trata de nenhuma opinião ou ideia específica.

O que está acontecendo é que uma ferramenta poderosa o suficiente para vigiar tudo o que é dito e feito na Internet (ou grande parte dela) está se tornando disponível para o governo monitorar todos nós, o tempo todo. E, com base nessa monitorização, o governo – e qualquer organização ou empresa com a qual o governo tenha parceria – pode então usar a mesma ferramenta para suprimir, silenciar e encerrar qualquer discurso que não lhe agrade.

Mas isso não é tudo. Utilizando a mesma ferramenta, o governo e os seus parceiros público-privados e “não governamentais” (pense, por exemplo: a Organização Mundial de Saúde, ou a Monsanto) também podem encerrar qualquer actividade que esteja ligada à Internet. Operações bancárias, compras, vendas, ensino, aprendizagem, entretenimento, conexão entre si – se a IA controlada pelo governo não gostar do que você (ou seus filhos!) diz em um tweet ou e-mail, ela pode encerrar tudo isso por você.

Sim, temos visto isto numa escala muito local e politizada com, por exemplo, os caminhoneiros canadenses.

Mas se pensássemos que este tipo de actividade não poderia, ou não iria, acontecer numa escala nacional (ou ainda mais assustadora – global), precisamos de acordar agora e perceber que está a acontecer, e que pode não ser parável.

Novos documentos mostram IA financiada pelo governo destinada à censura online

O Subcomitê Selecionado da Câmara dos EUA sobre o Armamento do Governo Federal foi formada em janeiro de 2023 “para investigar questões relacionadas à coleta, análise, disseminação e uso de informações sobre cidadãos dos EUA por agências do poder executivo, incluindo se tais esforços são ilegais, inconstitucionais ou de outra forma antiéticos”.

Infelizmente, o trabalho da comissão é visto, mesmo pelos seus próprios membros, como em grande parte político: os legisladores conservadores estão a investigar o que consideram ser o silenciamento de vozes conservadoras por parte de agências governamentais de tendência liberal.

No entanto, nas suas investigações, esta comissão descobriu alguns documentos surpreendentes relacionados com tentativas do governo de censurar o discurso dos cidadãos americanos.

Estes documentos têm implicações cruciais e aterrorizantes para toda a sociedade.

No relatório provisório do Subcomitê, datado de 5 de fevereiro de 2024, documentos mostram que grupos acadêmicos e sem fins lucrativos estão apresentando a uma agência governamental um plano para usar “serviços de desinformação” de IA para censurar conteúdo em plataformas da Internet.

Especificamente, a Universidade de Michigan está explicando à National Science Foundation (NSF) que as ferramentas baseadas em IA financiadas pela NSF podem ser usadas para ajudar as plataformas de mídia social a realizar atividades de censura sem ter que realmente tomar decisões sobre o que deve ser censurado.

Veja como o relacionamento é visualizado no relatório do Subcomitê:

Aqui está uma citação específica apresentada no relatório do Subcomitê. Vem das “Notas do palestrante da primeira apresentação da Universidade de Michigan à National Science Foundation (NSF) sobre sua ferramenta WiseDex financiada pela NSF e alimentada por IA”. As notas estão arquivadas no comitê.

Nosso serviço de desinformação ajuda os formuladores de políticas em plataformas que desejam…transferir a responsabilidade por julgamentos difíceis para alguém de fora da empresa…externalizando a difícil responsabilidade da censura.

Esta é uma declaração extraordinária em muitos níveis:

- Equivala explicitamente “serviço de desinformação” à censura.

Esta é uma equação crucial, porque os governos de todo o mundo fingem combater a desinformação prejudicial quando na verdade estão aprovando projetos de censura massivos. O WEF declarado “desinformação e desinformação” serão os “riscos globais mais graves” nos próximos dois anos, o que presumivelmente significa que os seus maiores esforços irão para a censura.

Quando um contratante governamental declara explicitamente que está a vender um “serviço de desinformação” que ajuda as plataformas online a “externalizar a censura” – os dois termos são reconhecidos como intercambiáveis.

- Refere-se à censura como uma “responsabilidade”.

Por outras palavras, assume que parte do que as plataformas deveriam fazer é censura. Não proteger as crianças de predadores sexuais ou cidadãos inocentes da desinformação – apenas censura pura e simples e não adulterada.

- Afirma que o papel da IA é “externalizar” a responsabilidade pela censura.

As plataformas tecnológicas não querem tomar decisões de censura. O governo quer tomar essas decisões, mas não quer ser visto como censor. As ferramentas de IA permitem que as plataformas “externalizem” as decisões de censura e que o governo esconda as suas atividades de censura.

Tudo isto deverá acabar com a ilusão de que aquilo que os governos de todo o mundo chamam de “combate à desinformação e ao discurso de ódio” não é censura pura e simples.

O que acontece quando a censura de IA é totalmente implementada?

Sabendo que o governo já está pagando por ferramentas de censura de IA, temos que entender o que isso implica.

Sem limites de mão de obra: Tal como salienta o relatório do Subcomité, os limites à censura governamental online têm, até agora, envolvido o grande número de humanos necessários para analisar intermináveis ficheiros e tomar decisões de censura. Com a IA, quase nenhum ser humano precisa estar envolvido, e a quantidade de dados que pode ser monitorada pode ser tão vasta quanto tudo o que alguém diz em uma plataforma específica. Essa quantidade de dados é incompreensível para um cérebro humano individual.

Ninguém é responsável: Um dos aspectos mais assustadores da censura da IA é que, quando a IA o faz, não há nenhum ser humano ou organização – seja o governo, as plataformas ou a universidade/organizações sem fins lucrativos – que seja realmente responsável pela censura. Inicialmente, os humanos alimentam a ferramenta de IA com instruções sobre quais categorias ou tipos de linguagem censurar, mas depois a máquina segue em frente e toma as decisões caso a caso sozinha.

Nenhum recurso para reclamações: Assim que a IA for desencadeada com um conjunto de instruções de censura, ela varrerá zilhões de pontos de dados online e aplicará ações de censura. Se quiser contestar uma ação de censura da IA, terá que falar com a máquina. Talvez as plataformas empreguem humanos para responder aos apelos. Mas por que fariam isso, se têm IA que pode automatizar essas respostas?

Nenhuma proteção para os jovens: Uma das alegações feitas pelos censores do governo é que precisamos de proteger os nossos filhos de informações online prejudiciais, como conteúdos que os tornem anoréxicos, os encorajem a cometer suicídio, os transformem em terroristas do ISIS, e assim por diante. Também da exploração sexual. Todas essas são questões sérias que merecem atenção. Mas não são tão perigosas para um grande número de jovens como a censura da IA.

O perigo representado pela censura da IA aplica-se a todos os jovens que passam muito tempo online, porque significa que as suas atividades e linguagem online podem ser monitorizadas e usadas contra eles – talvez não agora, mas sempre que o governo decidir perseguir um determinado tipo de censura. de linguagem ou comportamento. Este é um perigo muito maior para um número muito maior de crianças do que o perigo representado por qualquer conteúdo específico, porque abrange todas as atividades que realizam online, afetando quase todos os aspectos das suas vidas.

Aqui está um exemplo para ilustrar esse perigo: digamos que seu filho adolescente jogue muitos videogames interativos online. Digamos que ele prefere jogos desenvolvidos por empresas chinesas. Talvez ele também observe outros jogarem esses jogos e participe de bate-papos e grupos de discussão sobre esses jogos, dos quais também participam muitos cidadãos chineses.

O governo poderá decidir no próximo mês, ou no próximo ano, que qualquer pessoa fortemente envolvida em videojogos de design chinês é um perigo para a democracia. Isso pode resultar no encerramento das contas de mídia social do seu filho ou na negação de seu acesso a ferramentas financeiras, como empréstimos para faculdade. Também pode envolver sinalizá-lo em sites de emprego ou namoro como perigoso ou indesejável. Isso pode significar que seu passaporte será negado ou colocado em uma lista de vigilância.

A vida do seu adolescente ficou muito mais difícil. Muito mais difícil do que se ele fosse exposto a um vídeo de recrutamento do ISIS ou a uma postagem no TikTok que glorificava o suicídio. E isso aconteceria em uma escala muito maior do que a exploração sexual que os censores estão usando como um Cavalo de Tróia para normalizar a ideia de censura governamental online.

Serviços de censura monetizáveis: Uma ferramenta de IA de propriedade do governo pode, teoricamente, ser usada por uma entidade não governamental com a permissão do governo e com a bênção das plataformas que desejam “externalizar” a “responsabilidade” pela censura. Assim, embora o governo possa estar a utilizar a IA para monitorizar e suprimir, digamos, como exemplo, o sentimento anti-guerra – uma empresa poderia usá-la para monitorizar e suprimir, digamos, como exemplo, o sentimento anti-fast food. O governo poderia ganhar muito dinheiro vendendo os serviços das ferramentas de IA a terceiros. As plataformas também poderiam pedir uma redução. Assim, as ferramentas de censura de IA podem beneficiar potencialmente o governo, as plataformas tecnológicas e as empresas privadas. Os incentivos são tão poderosos que é quase impossível imaginar que não serão explorados.

Podemos reverter o curso?

Não sei quantas agências governamentais e quantas plataformas utilizam ferramentas de censura de IA. Não sei com que rapidez eles podem aumentar.

Não sei que ferramentas temos à nossa disposição – para além da sensibilização e da tentativa de fazer lobby junto dos políticos e de intentar ações judiciais para evitar a censura governamental e regular a utilização de ferramentas de IA na Internet.

Se alguém tiver outras ideias, agora é a hora de implementá-las.

Publicado sob um Licença Internacional Creative Commons Attribution 4.0

Para reimpressões, defina o link canônico de volta ao original Instituto Brownstone Artigo e Autor.